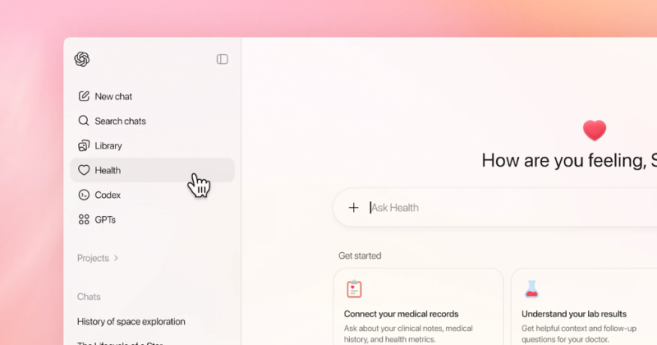

En janvier 2026, OpenAI a mis en ligne aux États-Unis « ChatGPT Health », une plateforme spécialisée qui permet aux utilisateurs d’importer leurs dossiers médicaux et les données de leurs applications de santé.

Dans le même temps, Anthropic a déployé « Claude for Healthcare », une solution orientée vers les entreprises de santé, qui s'intègre aux standards médicaux.

Ces outils ne sont plus que des agents de discussion généralistes, mais deviennent des interfaces de gestion de données cliniques.

Manque de précision inquiétant

Une étude publiée en février 2026 dans Nature Medicine a mesuré la fiabilité de ChatGPT Health dans l'orientation des patients. L'équipe du Dr Ashwin Ramaswamy a soumis l'outil à environ 1 000 variantes de 60 scénarios médicaux.

Les données statistiques de l'étude soulignent de graves erreurs de jugement :

- Sous-tri* (51,6 %) : dans plus de la moitié des cas d'urgence vitale, l'IA n'a pas recommandé de visite immédiate aux urgences. Pour des pathologies comme l'acidocétose diabétique ou l'insuffisance respiratoire, elle a préconisé un suivi sous 24 à 48 heures.

- Sur-tri* (64,8 %) : Pour des cas bénins, l'outil a fréquemment conseillé des consultations médicales inutiles.

- Performance sur les cas types : Les symptômes classiques d'AVC ou de réactions allergiques sévères ont été correctement identifiés dans 100 % des tests.

Les tests effectués en faisant varier le genre ou l'origine ethnique des patients n'ont révélé aucune différence significative dans les recommandations de l'IA. L'absence de prise en compte de biais démographiques démontre que l'IA manque de précision clinique, au-delà des erreurs avérées.

L'étude souligne des incohérences dans le raisonnement logique du modèle. Dans des cas d'asthme sévère, l'IA a listé par écrit les signes cliniques d'une défaillance respiratoire mais conclue par une recommandation de soins non urgents.

OpenAI a répondu à ces résultats en précisant que l'outil est conçu pour fonctionner de manière itérative (par questions-réponses successives) et non pour fournir une recommandation à partir d'un exposé de faits statique.

Enjeux de la centralisation des données de santé

Pour lever les réticences des cliniciens, OpenAI et Anthropic ont instauré des protocoles stricts : les données de santé partagées via ces plateformes sont stockées dans des environnements isolés et, selon les entreprises, ne sont pas utilisées pour entraîner leurs modèles de langage globaux.

Cette séparation étanche est présentée comme la condition sine qua non de l'adoption de l'IA dans un cadre professionnel conforme aux normes de protection des données.

Le dossier médical, un nouvel actif pour la Big Tech ?

L'incitation des utilisateurs à uploader l'intégralité de leur historique médical dans ces systèmes soulève une question fondamentale : peut-on confier ces données à des entreprises privées à but lucratif ?

D'un côté, la promesse est séduisante : une IA capable de croiser dix ans de résultats d'analyses avec vos habitudes de sommeil peut détecter des signaux faibles qu'un humain, par manque de temps, ignorerait. C'est la promesse d'une médecine hyper-personnalisée et préventive.

De l'autre, le risque de dépendance et de marchandisation est réel. Si ces modèles deviennent l'infrastructure même du système de santé, le contrôle de la donnée de santé passe des institutions publiques ou médicales vers des géants technologiques dont les intérêts (rentabilité, croissance, actionnariat) ne sont pas nécessairement alignés avec ceux des patients.

Même sans « entraîner » le modèle, posséder l'accès à des informations de santé de millions d'individus confère un pouvoir d'influence inédit : sur les parcours de soins, sur les recommandations d'assurance ou sur les choix thérapeutiques...

*Le sous-tri minimise la gravité d’un état et prive le patient de soins urgents vitaux, alors que le sur-tri encombre inutilement les hôpitaux par des recommandations excessives pour des cas bénins.

![[Vidéo] La vision d'EssilorLuxottica place l'opticien au coeur des transformations de la filière optique](https://www.acuite.fr/sites/acuite.fr/files/styles/home_slider_video/public/articles/chrystel_barranger_switch_essilorluxottica_opticien_2026_transformation_filiere_optique_lunetterie_ia_interview.png?itok=lTn2X84K)

Puisque nous (l'humanité) sommes prévenus, nous allons (évidemment) être prudents et prendre la bonne direction.

...

Ou pas ;-)